IMI-Standpunkt 2020/014

Cyber Valley: Forschungsgruppe von US-Geheimdiensten finanziert

von: Christoph Marischka | Veröffentlicht am: 21. April 2020

Unter dem Titel „Künstliche Intelligenz und Yoga im Freien“ berichtete das Schwäbische Tagblatt am 17. Januar über das aktuelle Semesterprogramm der VHS Gomaringen – einer Gemeinde mit etwa 9.000 Einwohnerinnen südlich von Tübingen. Besonders hingewiesen wurde u.a. auf den Vortrag am 10. März von „Fabian Sinz, Leiter der Forschungsgruppe ‚Neuronal Intelligence‘ beim Cyber Valley Tübingen, zum Thema ‚Warum wir immer noch schlauer als Maschinen sind’“. Beim Besuch der Homepage dieser Arbeitsgruppe springt einem zunächst eine Art Anzeige von Amazon Web Services ins Auge, die für den AWS Machine Learning Award – einem von Amazon ausgelobten Wissenschaftspreis im Bereich des Maschinellen Lernens – wirbt. Als Thema wird der Aufbau „sehr datenintensiver prädiktiver Modelle des visuellen Kortex‘ von Mäusen“ benannt. Aber das ist nur eine Nebengeschichte. Spektakulär ist, dass diese Forschungsgruppe bereits seit 2018 unmittelbar von der US-Agentur für Geheimdienstforschung finanziert wird.

Die Forschungsgruppe ist Kernbestandteil des sog. Cyber Valley. Bereits in jener Pressemitteilung Ende 2016, mit der die baden-württembergische Landesregierung, die Max-Planck-Gesellschaft und die Industrie die Gründung des Forschungsclusters bekanntgaben, wurde die Bildung dieser Forschungsgruppen angekündigt, die den Wissenstransfer zwischen Wissenschaft und Wirtschaft garantieren sollten. Neben all den Netzwerken und Kooperationen, die sich in diesem „Ökosystem“ zwischen Politik, Wissenschaft und Industrie auch eher informell bilden sollen, gehören diese Forschungsgruppen und v.a. deren Finanzierungsmodell zu jenen, die noch am klarsten ausformuliert sind. Zwar sind die zugrunde liegenden Verträge der Forschungskooperation bis heute trotz intensiver zivilgesellschaftlicher Forderungen und mehrfachen Beteuerungen der Beteiligten nicht öffentlich. Im Zuge der Proteste gegen das Cyber Valley und der Kontoverse um das damit verbundene Entwicklungszentrum für Maschinelles Lernen des Amazon-Konzerns wurde jedoch für die Überwachung der öffentlich-privaten Finanzierung dieser Forschungsgruppen ein sog. „Cyber Valley Public Advisory Board“ eingerichtet. Der Öffentlichkeit wurde dies als „Ethikbeirat“ verkauft und war damit Grund genug für den Tübinger Gemeinderat, seinen Kotau vor dem Cyber Valley zu machen und für den Amazon-Bau öffentlichen Grund zu einem Spottpreis zu an den Projektentwickler Reisch GmbH zu verkaufen (siehe ST vom 14.11.2019). Auch das ist nur eine Nebengeschichte hier, aber Digitalisierung ist eben immer auch Privatisierung.

„Ethik“

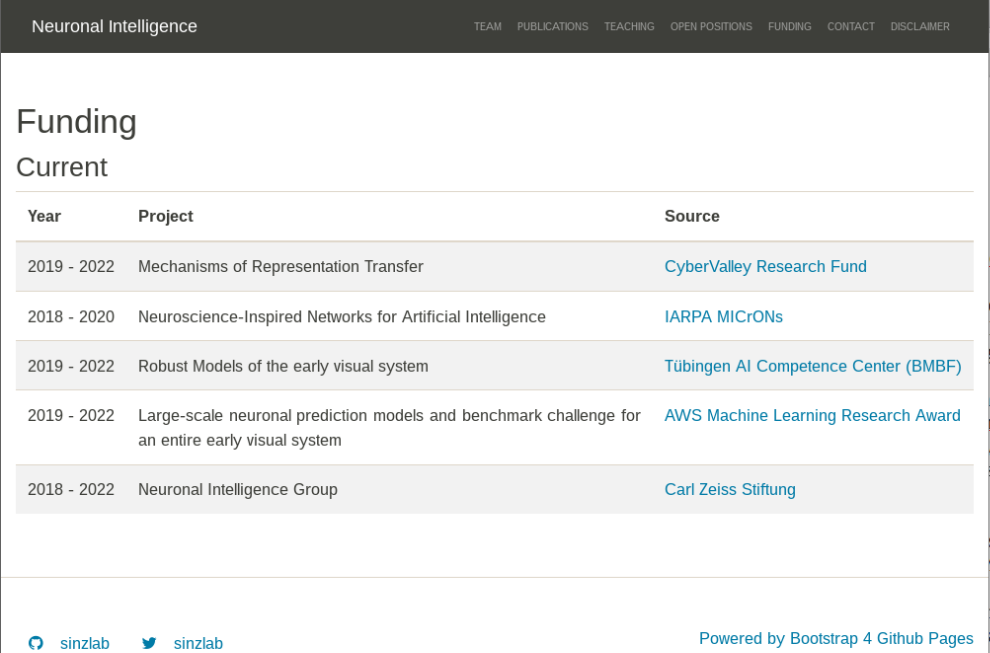

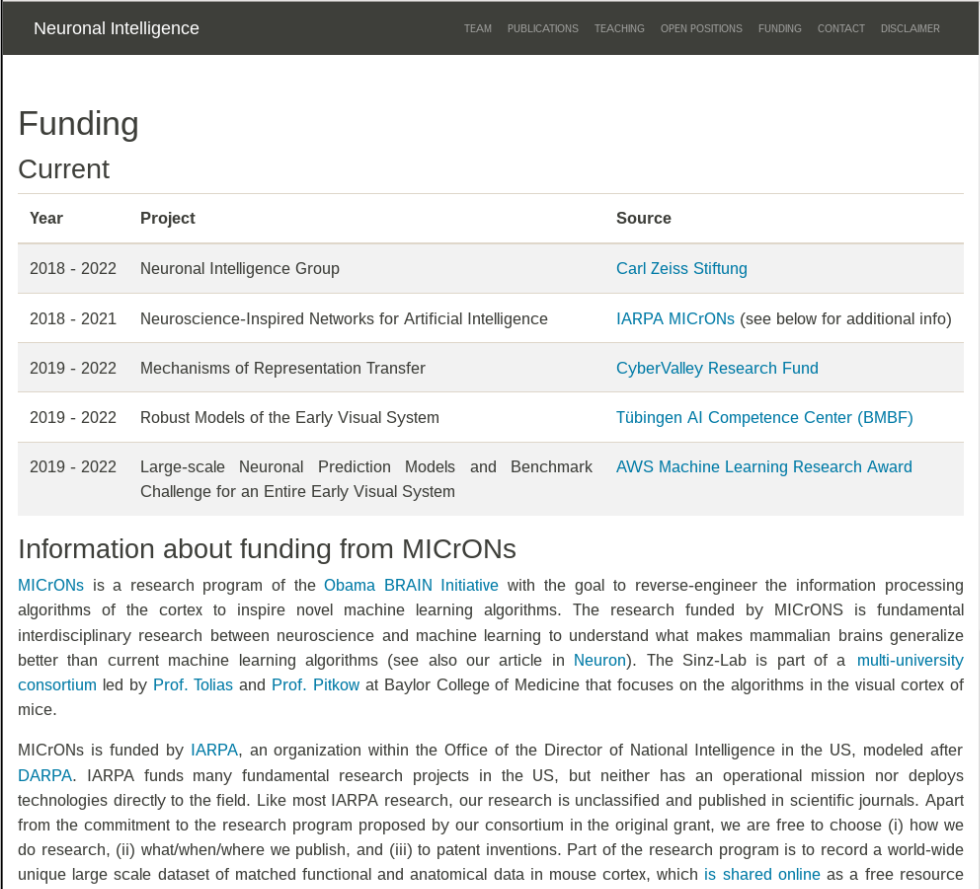

„In die Forschung des geplanten Amazon-Entwicklungszentrums, des Bosch-Forschungszentrums, des MPIs und der erhofften Startups wird dieser Ethikbeirat keinerlei Einblick haben. Kritische Forschungsvorhaben können problemlos am Gremium vorbei als Drittmittelprojekte, in Startups oder den Entwicklungszentren durchgeführt werden und trotzdem Angehörige der Uni oder des MPI einbeziehen“, warnte damals eine studentische Gruppe gemeinsam mit dem „Bündnis gegen das Cyber Valley“. Kommen wir zurück zur konkreten Forschungsgruppe ‚Neuronal Intelligence‘. Diese wird tatsächlich vom Cyber Valley Research Fund finanziert, der über den sog. Ethikbeirat angeblich kontrolliert wird. Als Finanzierungsquellen gibt die Forschungsgruppe neben Amazon Web Services und der Carl Zeiss Stiftung eben jenen Cyber Valley Research Fund an. Darüber hinaus sind das Bundesministerium für Bildung und Forschung (BMBF) mit seiner Unterstützung für das „Tübingen AI Competence Center“ und das IARPA-Programm „MICrONs“ benannt.

Die Homepage des im Rahmen von „MICrONs“ geförderten Projekts NINAI (Neuro-Inspired Networks for Artificial Intelligence), an dem die Cyber Valley Forschungsgruppe beteiligt ist, ist im Stil eines StartUps gehalten und liefert dementsprechend erstmal wenig brauchbare Informationen: „Wir sind Neurowissenschaftler*innen, Mediziner*innen, Mathematiker*innen und Informatiker*innen, die sich auf ein gemeinsames Ziel konzentrieren: Hirnforschung für eine maschinelle Intelligenz mit dem Ziel, eine weniger ‚künstliche‘ Intelligenz zu schaffen“. Dem Online-Auftritt ist nicht auf Anhieb – und auch nicht abschließend – zu entnehmen, ob es sich um ein StartUp-Unternehmen oder ein Forschungsprojekt handelt. Dass die Grenzen hier oft fließend gestaltet sind, auch um Gewinne zu privatisieren und Einschränkungen zu umgehen, ist in der Geschichte der US-Militär- und -Geheimdienstforschung nichts Neues. Ein Beispiel von vielen sind die Aktivitäten des Kognitionswissenschaftlers Alexander Waibel am KIT in Karlsruhe, der zugleich in Deutschland und den USA öffentlich finanziert wurde, nur in den USA jedoch seine wissenschaftlichen Erkenntnisse militärisch (DARPA) und geheimdienstlich (IARPA) hat fördern lassen und dann über die Gründung eines Unternehmens an diese vermarktet hat. Aber auch das ist wieder eine Nebenbaustelle.

Big-Data-Geheimdienstforschung

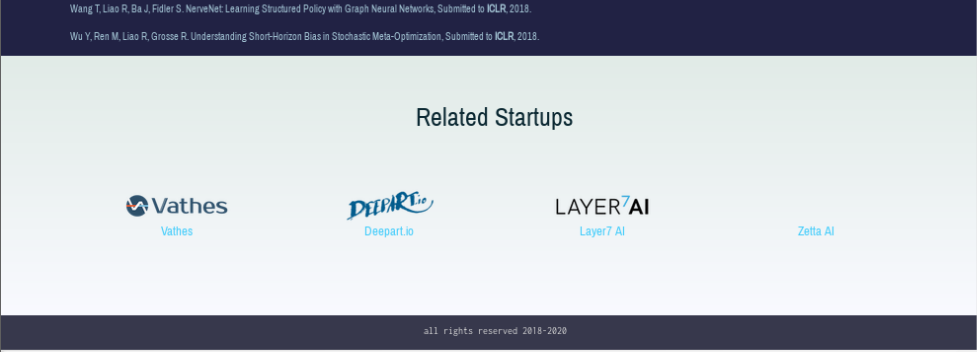

MICrONs jedenfalls ist bereits unter den (fünf) Finanzgebern der Arbeitsgruppe ‚Neuronal Intelligence‘ als „IARPA MICrONs“ benannt. Auf der Homepage des Projekts/StartUps NINAI wird als Ziel ausgegeben „Wir machen uns auf – in ein intensives Fünf-Jahres-Projekt finanziert von IARPA“. Der Link hinter IARPA lässt keine Zweifel mehr offen: Er führt direkt zum „Office of the Director of National Intelligence“ der USA: https://www.iarpa.gov/. Als „Verwandte StartUps“ werden am Ende der übersichtlichen Homepage von MICrONs drei genannt: Datajoint, Deepart und Layer7AI. Aber das ist auch schon wieder eine Nebenbaustelle…

Die IARPA ist zugleich eine Tochter- wie auch eine Schwesterorganisation der DARPA, der Forschungsagentur des Pentagon. Sie untersteht dem Director of National Intelligence, der sämtliche 16 US-Geheimdienste, darunter NSA und CIA sowie die Geheimdienste von Heer, Luftwaffe und Marine – die sog. „Intelligence Community“ – koordinieren soll. Sein Amt und das entsprechende Büro wurden 2004 im Zuge des Umbaus des US-Sicherheitsapparates in Folge des 11.9.2001 (Intelligence Reform and Terrorism Prevention Act) unter dem damaligen Präsidenten Bush geschaffen. Ab 2006 folgte der Aufbau der IARPA nach dem Vorbild der DARPA und auf Grundlage des „Büros für disruptive Technologien“ der NSA, die dem Verteidigungsministrium zugeordnet ist und ebenso wie die IARPA dem Director of National Intelligence untersteht. Laut Selbstdarstellung der IARPA sind deren Programme „einzigartig ausgestaltet, um die Forschung und die technischen Fähigkeiten der Intelligence Community bereitzustellen und deren langfristigen Bedürfnisse zu antizipieren. Wie man es dreht und wendet, die IARPA ist keine zivile Behörde, sondern arbeitet den militärischen Geheimdiensten der USA zu. Die Förderung durch die IARPA für die Forschungsgruppe ‚Neuronal Intelligence‘ läuft laut Angaben auf deren Website seit 2018.

Glatt gelogen!

Die Befürchtungen um ein „Transformation in einen Rüstungsstandort“ waren eine (von verschiedenen) Triebfedern der Protests gegen das Cyber Valley, der Mitte 2018 begann. Auf eine erste Kundgebung gegen das angestrebte „Ökosystem für die Entwicklung Künstlicher Intelligenz“ reagierte die Lokalpresse mit einem Beitrag unter dem Titel „Cyber-Valley-Initiative in Tübingen weist Vorwürfe der Militarisierung und des Ausverkaufs zurück“. Auf die Frage ob „sich die KI-Forschung in Tübingen für militärische Zwecke missbrauchen“ ließe, legt sich Forschungskoordinator Matthias Tröndle damals fest: „Wir haben keinerlei Projekte, die in diese Richtung gehen“. Auch Cyber-Valley-Koordinatorin Tamara Almeyda versicherte: „Wir machen keine militärische Forschung.“ Im Gegenteil: „Viele Wissenschaftler engagieren sich dagegen.“ Auch in den FAQs der Universität Tübingen zum Cyber Valley wird kategorisch festgestellt: „Nein, es gibt keine Rüstungsforschung – weder im Rahmen der Cyber Valley Initiative noch innerhalb der Universitäten und der Max-Planck-Institute.“ Zur „Dual Use – Problematik“ heißt es allerdings: „[Im] komplexen Spannungsfeld von Nutzen und Risiken ist die Forschung in der Max-Planck-Gesellschaft und den Universitäten dem Wohl der Menschheit und dem Schutz der Umwelt verpflichtet. Forscherinnen und Forscher aus dem Cyber Valley bringen sich deshalb weltweit aktiv in ethische Debatten ein und wenden sich beispielsweise gegen autonome Waffensysteme“.

Davon allerdings ist bislang nichts zu spüren. Selbst der Ethikbeirat hat offensichtlich nichts einzuwenden gegen eine öffentlich geförderte Forschung, von der sich neben Zeiss und Amazon v.a. die US-Geheimdienste Ergebnisse erhoffen. Das wissenschaftliche Aushängeschild des Cyber Valley, Bernhard Schölkopf, versichert bis heute auf seiner Homepage, dass er Forschung für aggressive militärische Zwecke ablehne: „I believe AI/ML should not be used for aggressive military purposes“. Das brachte ihm einigen Respekt und einigen Zuspruch ein – ist jedoch banal. „Aggressive military purposes“ sind eigentlich völkerrechtlich verboten und ebenso wie deren Zuarbeit teilweise sogar strafrechtlich sanktioniert. Genau deshalb werden sie immer wieder in humanitäre Interventionen umgedichtet.

Erst kürzlich zitierte das Schwäbische Tagblatt Schölkopf mit der Erklärung, „dass KI mit den Werten der offenen Gesellschaft Europas im Einklang stehen‘ muss“. Gerade die Nutzbarkeit entsprechender Forschung für Überwachung in Kriegführung wurde immer wieder als Argument dafür ins Feld geführt, dass das Cyber Valley hier entstehen solle, um die Weiterentwicklung dieser Technologien nicht den USA oder China zu überlassen. Auf dem Höhepunkt der Proteste gegen kam es zu einer Podiumsdiskussion vor gut 600 Zuhörer*innen, auf der eine der Beteiligten – Prof. von Luxburg, deren Lehrstuhl mittlerweile ebenfalls im Tübingen AI Center angesiedelt ist – das Projekt verteidigte: „Was wir wollen ist, die Forschung nicht den Anderen überlassen und denen zu sagen: Ihr macht verantwortungsvolle Forschung […] Wir wollen hier verantwortungsvolle Forschung durchführen. Prof. Hein, mit seiner Bosch-Stiftungsprofessur ebenfalls mittlerweile im „Tübinger AI Center“ untergebracht – bließ in dasselbe Horn: „Ich denke einfach, dass wir diese Forschung nicht eben China und den USA überlassen dürfen.“ Dass nun diese Forschung von der IARPA gemeinsam mit Amazon finanziert wird, erscheint da reichlich widersprüchlich.

Fließende Grenzen

Im Oktober 2018 berichtete das Schwäbische Tagblatt darüber, dass ein „Tübinger AI Center“ mit 6,6 Mio. Euro gefördert würde. „’Wir freuen uns sehr über die Förderung des Tübinger Kompetenzzentrums und sehen hier eine große Chance, künstliche Intelligenz maßgeblich zu gestalten‘, sagte Koordinator Matthias Bethge, Professor für Computational Neuroscience and Machine Learning an der Universität Tübingen“. Wofür die Gelder konkret verwendet wurden, ist schwer nachzuvollziehen, aber es entstand in der Zwischenzeit auf dem neuen Tübinger Forschungscampus ein Gebäude, mit eben diesem Namen, in dem nun Professuren der Uni, „Industry-on-Campus“-Projekte (v.a. von Bosch) und offenbar auch StartUp-Unternhemen, zumindest Layer7AI, ihren Sitz haben. Mitbegründer des StartUps Layer7AI ist Andreas Bethge, Professor an der Universität Tübingen und Koordinator des BMBF-geförderten Kompetenzzentrums, der neben Prof. Sinz auch als Mitglied des IARPA-Projekts NINAI genannt wird. Im Juli 2019 berichtete das Schwäbische Tagblatt über Layer7AI, dass es „eine Art Vorhersage-Tool [bietet], das etwa Umsatzentwicklungen prophezeien und Einkaufsstrategien verbessern soll. […] Zehn Mitarbeiter sind aktuell dabei, zudem werden immer wieder Forscher von der Uni und dem Max-Planck-Institut (MPI) in Vollzeit ausgeliehen“.

Bis heute gibt das Unternehmen – offenbar partnerschaftlich verbunden mit dem IARPA-Projekt – die Adresse des „Tübinger AI Center“ an, das zwischen den Max-Planck-Instituten, der Baustelle des Amazon-Entwicklungszentrums und des Startups CureVacs in wenigen Monaten hochgezogen wurde – und nach außen schlicht den Eindruck eines informatischen Instituts vermittelt. Es gibt dort viele unbeschriftete Briefkästen neben dem einen, der mit „Universität Tübingen“ bezeichnet ist. Das Personal der universitären Forschungsgruppe Bethges, seiner Startup-Unternehmen Layer7AI und Deepart.io (beide gleichermaßen als Partnerprojekte des IARPA-Projekts NINAI genannt) überschneidet sich an einigen Stellen, Mitglieder der „Teams“ beider StartUps werden auch als Mitglieder des IARPA-Projekts NINAI genannt. Das „Bethge Lab“, dessen konkrete Verortung zwischen Universität, Startups, Cyber Valley und dem Tübingen AI Center schwer einzuordnen ist, gibt als Finanzierungsquelle von 2015 bis 2019 ebenfalls das IARPA-Forschungsprogramm MICrONs an.

Aktualisierung (27.4.2020)

Mittlerweile (27.4.2020) wurden (mindestens) zwei der hier verlinkten Homepages verändert. Das Sinzlab hat bei der Angabe seiner Finanzierungsquelle eine Erläuterung zur IARPA und dem Projekt MICrONs ergänzt. Auf der Homepage der Arbeitsgruppe NINAI werden nun die Startups, an denen Prof. Bethge beteiligt ist, nicht mehr als „Related Startups“ angegeben, wie folgenden Screenshots, jeweils vom 21.4.2020 und vom 27.4.2020 zu entnehmen ist.